De la web a la clínica: retos y oportunidades de la IA aplicada a las veterinarias

En la vorágine de cambios constantes que ofrece la IA en el ámbito laboral, la British Veterinary Association ha elaborado un informe en el que desgranan las particularidades de la inteligencia artificial en veterinaria y ofrecen soluciones innovadoras para un uso ético y responsable de esta tecnología.

Estado: Esperando

El principal reto para prácticamente todo el sistema laboral es adaptarse a las ventajas que otorga implementar la Inteligencia Artificial (IA) al día a día. Las empresas se están reestructurando para asimilar estas nuevas tecnologías de la manera más eficiente posible, y las entidades reguladoras corren a contrapié para establecer un marco ético. Sin ...

El principal reto para prácticamente todo el sistema laboral es adaptarse a las ventajas que otorga implementar la Inteligencia Artificial (IA) al día a día. Las empresas se están reestructurando para asimilar estas nuevas tecnologías de la manera más eficiente posible, y las entidades reguladoras corren a contrapié para establecer un marco ético. Sin embargo, no todos los sectores se adaptarán a la misma velocidad, ni sus profesionales mostrarán las mismas reticencias.

Uno de los ámbitos más sensibles se halla en los relativos a las ciencias de la salud. Un mal diagnóstico o una recomendación errónea pueden suponer en situaciones irreversibles para el paciente, y es por ello que delegar este tipo de responsabilidades a una tecnología que no controlan es una cosa que los profesionales sanitarios no ven con demasiados buenos ojos.

En este momento de transición tecnológica sin precedentes, la British Veterinary Association (BVA) ha publicado un informe que tiene como objetivo guiar el futuro de la medicina veterinaria. El Policy Position on Artificial Intelligence in the Veterinary Profession —Posición reguladora sobre la inteligencia artificial en la profesión veterinaria—, publicado en diciembre de 2025, expone un conjunto de recomendaciones para la adopción tecnológica de estos sistemas en la profesión. El documento exhibe desde el primer momento cómo la opinión generalizada entre los veterinarios no es precisamente positiva: una encuesta interna conducida por la propia BVA revela que mientras el 21% de los veterinarios ya utiliza IA en la práctica clínica, un 40% no planea hacerlo y un 42% se muestra indeciso. Esta divergencia subraya la urgencia de un marco común que evite brechas peligrosas y garantice que la revolución digital sirva por igual a animales, profesionales y sociedad.

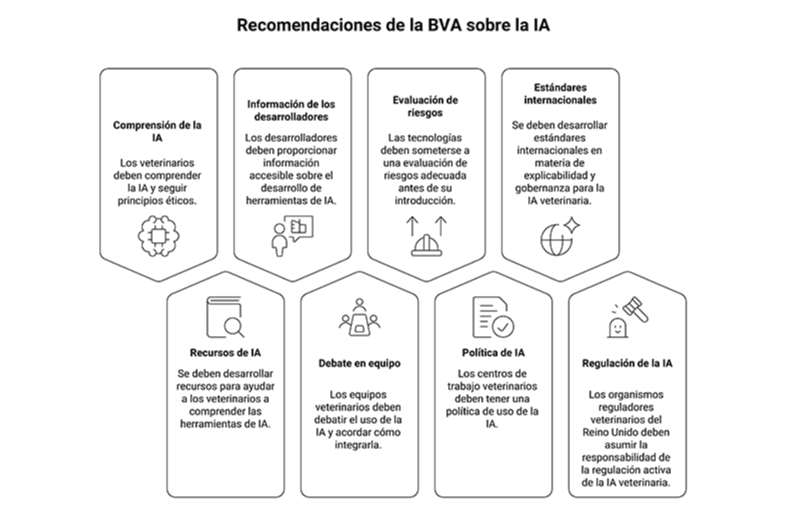

Así, desde la asociación se establece desde el principio una premisa central: la inteligencia artificial debe entenderse como una herramienta de apoyo al juicio clínico, jamás como sustituto del profesional. De este modo, la BVA adopta una postura decididamente proactiva pero cautelosa, abogando por un enfoque "positivo y abierto de mente" que vea en la IA un aliado transformador, siempre que su desarrollo e implementación se rijan por principios de transparencia y ética. Los pilares de una adopción responsable La columna vertebral del posicionamiento de la BVA se ha articulado en ocho principios generales, cuidadosamente elaborados para servir como brújula en un terreno en constante evolución.

1. La IA como herramienta. El principio fundacional establece que la inteligencia artificial es, en esencia, una herramienta más dentro del arsenal del veterinario, y por lo tanto su razón de ser es potenciar y aumentar las capacidades del profesional, nunca reemplazar su juicio clínico, experiencia y empatía. Sin embargo, existe una diferencia crítica respecto a las herramientas tradicionales: mientras que el mal uso de un instrumento físico suele tener consecuencias evidentes e inmediatas (una mala lectura, un diagnóstico erróneo), los fallos de la IA pueden ser opacos, sistémicos y difíciles de detectar, es por este motivo por el cual la posición del veterinario a la hora de revisar y validar ha de ser proactiva y constante, con la responsabilidad implícita que esto conlleva.

2. La alfabetización en inteligencia artificial (AI literacy). Dada la naturaleza compleja de esta innovación, el segundo principio dirime el desarrollo de una "alfabetización" en IA por parte de todos los profesionales veterinarios. Este pilar va más allá de saber utilizarlas de manera recreativa, e implica la comprensión de los mecanismos básicos (entender cómo funciona un modelo, qué son datos de entrenamiento, y cómo se genera una predicción) y capacidad de validación crítica para poder contrastar los resultados generados por la IA con el conocimiento clínico establecido, las mejores prácticas y la evidencia científica. En definitiva, el veterinario debe ser capaz de responder: "¿Por qué debería confiar en este resultado?". Esta comprensión es la base para evitar la aceptación errónea de los resultados y para mantener al profesional como el árbitro final de la verdad clínica.

3. Veterinarios en el desarrollo de la IA. Las principales aplicaciones de IA que se utilizan son los modelos extensos de lenguaje (LLM, por sus siglas en inglés). La gran mayoría de ellas, como ChatGPT o Gemini, son modelos que se entrenan a partir de conocimiento previo publicado, pero a veces éste no es necesariamente revisado ni aceptado por la comunidad científica. Es por ello que este principio es un llamamiento a la agencia y al liderazgo profesional en el sector. Los veterinarios no pueden ser meros usuarios pasivos de tecnologías diseñadas por terceros ajenos a la realidad clínica, y por ello deben participar activamente en el diseño, para asegurar que la herramienta aborda un problema real; el desarrollo, definiendo parámetros, señales de alerta y criterios clínicamente relevantes, y en la validación, verificando su precisión, seguridad y utilidad antes de su implementación generalizada. Esta participación es la garantía de que la IA estará al servicio de la medicina veterinaria y no al revés, y de que incorporará la riqueza del conocimiento basado en la evidencia y la experiencia práctica.

4. Conciencia y gestión del sesgo. Este pilar aborda uno de los peligros más insidiosos de la IA. Los sesgos no son un error ocasional, sino un riesgo estructural que puede surgir de datos de entrenamiento no representativos, o algoritmos que reflejan prejuicios sociales. La BVA enfatiza que la conciencia de este riesgo no es suficiente; se requiere una vigilancia activa. Esto implica preguntar a los desarrolladores sobre la composición de los datos de entrenamiento, exigir auditorías de equidad y estar atentos a patrones de error que sugieran un sesgo en la práctica diaria.

5. Confianza y agilidad. La velocidad del cambio tecnológico es vertiginosa y exponencial. El quinto principio reconoce que los veterinarios deben cultivar una dualidad: la confianza para adoptar herramientas que demuestren su valor, y la agilidad mental y profesional para adaptarse a nuevas versiones, funcionalidades y paradigmas. Esto requiere un compromiso con el aprendizaje y una mente abierta para reevaluar procedimientos establecidos a expensas de nuevas capacidades, sin caer en la adopción precipitada o resistencia irreflexiva.

6. Consentimiento, privacidad y confianza con el cliente. El uso de la IA a menudo implica flujos complejos de datos que pueden salir del control directo de la clínica (cuando se usan servicios en la nube, por ejemplo). Este principio establece que los veterinarios, en su papel de controladores de datos, tienen una responsabilidad legal (bajo reglamentos como el UK GDPR) y ética, en la que deben informar con transparencia, donde expliquen a los clientes qué datos de sus animales se recogen, con qué fin, si se compartirán con proveedores de IA y qué salvaguardas existen; obtener un consentimiento genuino, basado en la comprensión, no en la mera firma de un formulario, y garantizar la seguridad, eligiendo proveedores tecnológicos con sólidos protocolos de ciberseguridad. La gestión ética de los datos no es solo un requisito legal, es una necesidad para mantener y fortalecer la relación de confianza con el cliente, para la que hará falta comunicación constante y transparencia absoluta.

7. Supervisión humana y responsabilidad. El séptimo principio ancla la tecnología a la ética profesional. La IA, especialmente en contextos de alto riesgo (diagnóstico, tratamiento), debe operar bajo una "supervisión humana significativa", detalla el informe. La BVA describe dos modelos clave: Human-in-the-loop (HITL), en el que profesional forma parte integral del proceso, revisando y validando cada paso clave antes de que el sistema avance, y el Human-on-the-loop (HOTL), dónde el profesional supervisa el funcionamiento del sistema, con la capacidad y el deber de intervenir y anular decisiones cuando sea necesario. El objetivo no es crear un cuello de botella, sino integrar la inteligencia humana para maximizar los beneficios de la IA y mitigar sus riesgos.

8. Explicabilidad. El principio final exige que la IA en veterinaria sea explicable. En una profesión basada en la confianza (del cliente en el veterinario y del veterinario en sus herramientas), los procesos no pueden ser ineficientes por la falta de seguridad. Este proceso significa que el veterinario debe poder comprender los factores principales que llevan a una recomendación, los auxiliares y técnicos deben entender el papel y las limitaciones de las herramientas que se utilizan en la clínica, y el cliente debe recibir una explicación comprensible de cómo una tecnología ha contribuido al diagnóstico o plan de tratamiento de su animal.

La pirámide del riesgo: un mapa para navegar la complejidad

Una de las contribuciones más prácticas del informe es la introducción de una Pirámide de Riesgo de los Casos de Uso, una infografía inspirada en la legislación europea que ayuda a clasificar las aplicaciones de IA según su potencial de daño, estratificadas en cuatro niveles acorde al riesgo.

En la cúspide, marcadas como inaceptables, se sitúan actividades como el diagnóstico o tratamiento completamente automatizado sin intervención humana, o la compartición irresponsable de datos personales. Estos son considerados de un riesgo inherente tan alto que su implementación sería contraria a la ética profesional, y de una potencialidad lesiva inaceptable. El siguiente nivel, de alto riesgo, incluye el apoyo a la toma de decisiones clínicas, las herramientas de triaje y diagnóstico, y la gestión de personal. Aquí, la IA informa o sugiere, pero la decisión final y la responsabilidad recaen en el humano, quien debe ejercer un escrutinio informado. En el nivel moderado se encuentran usos como el análisis de historiales clínicos para investigación o la automatización de comunicaciones con clientes, que habitualmente son rutinarias y su descarga, siempre con cierto grado de supervisión, puede ayudar al rendimiento del veterinario. Finalmente, en la base de mínimo riesgo, se sitúan tareas puramente administrativas o de marketing, cuyo impacto en caso de error es muy corregible.

Esta pirámide representa con claridad cómo el riesgo no depende solo de la herramienta en sí, sino del grado de autonomía que se le concede y de la influencia que tiene sobre decisiones que afectan la salud y el bienestar. Como señala el informe, "el riesgo aumenta exponencialmente con el grado de autonomía". Esta herramienta empodera a las clínicas para realizar evaluaciones de riesgo contextualizadas, preguntándose no solo qué hace esta tecnología, sino qué poder de decisión tiene en un proceso crítico.

Oportunidades y riesgo sistémico

El documento de la BVA reconoce tanto el potencial transformador de la IA como sus peligros sistémicos. Entre las oportunidades, por ejemplo, destaca la posibilidad de aliviar la carga administrativa, un factor clave en el desgaste profesional y la fuga de talento, gestionando agendas, generando recordatorios, o redactando notas clínicas. En el ámbito clínico puro, esta innovación promete mejorar el diagnóstico a través del análisis de imágenes, siendo el principal objetivo de estudio entre los investigadores de este campo, y para la salud pública y la investigación su potencial es enorme: desde modelar la propagación de enfermedades hasta acelerar el descubrimiento de fármacos y reducir la dependencia de la experimentación animal, un punto en el que el informe hace especial hincapié citando la hoja de ruta del gobierno británico.

Sin embargo, la BVA no elude los riesgos. El más inmediato es la creación de una "brecha digital" dentro de la propia profesión y entre los clientes. Aquellos que adopten la IA con confianza podrían ofrecer servicios más eficientes y accesibles, mientras que quienes se resistan o no tengan acceso podrían quedar en desventaja. Esta confección no puede ser algo obviable por las administraciones públicas, que deben establecer un marco de acción ecuánime y que promueva la adopción de esta tecnología en todo el sistema veterinario.

Otro riesgo fundamental es la erosión de la confianza en el diagnóstico profesional. Los propietarios, cada vez más expuestos a herramientas de IA como los LLM, pueden llegar a cuestionar los diagnósticos veterinarios basándose en información incompleta o errónea generada por una máquina. Esto coloca al profesional en la delicada posición de tener que educar al cliente sobre los límites de la tecnología mientras mantiene una relación de confianza.

De los principios a la práctica

La sección sobre implicaciones éticas traduce los principios, que pueden sonar a abstractos, en dilemas concretos y soluciones prácticas. La BVA estructura éstas en varios niveles. En primer lugar, la responsabilidad última no puede delegarse. "Si definimos a un profesional como alguien dispuesto a aceptar la responsabilidad por su experiencia, entonces la aplicación ética de la IA requiere que la persona que asume el riesgo siga siendo el tomador de decisiones", afirma el texto. Esto se traduce en la necesidad imperiosa de mantener un "humano en el circuito" para cualquier caso de uso que implique juicio profesional.

Por otro lado, la transparencia es una obligación bidireccional: los desarrolladores deben ser transparentes con los veterinarios sobre el funcionamiento de sus herramientas, y los veterinarios deben ser transparentes con los clientes sobre cuándo y cómo utilizan la IA. Finalmente, la BVA propone que cada centro veterinario elabore su propia política de uso de IA, un documento vivo que establezca límites claros, protocolos de consentimiento, directrices para la comunicación con el cliente y planes de formación continua para el equipo, ya que probablemente ésta tenga la capacidad de adaptarse a las particularidades de cada entorno de trabajo.

El documento culmina con ocho recomendaciones concretas que buscan constituir un plan de acción para la profesión, los desarrolladores y los reguladores. A los veterinarios, se les insta a comprometerse activamente con la comprensión de la IA, a discutir su uso en equipo y a implementar políticas y evaluaciones de riesgo antes de adoptar cualquier tecnología. A los desarrolladores, se les exige que proporcionen información accesible y explicable sobre cómo se construyen y validan sus herramientas.

Puedes leer el artículo completo en el PDF adjunto.